PRESSEMELDUNG

15. Mai 2024

Apple kündigt neue Bedienungshilfen an, darunter Eye Tracking, Music Haptics, Vocal Shortcuts und mehr

Zu den neuen Bedienungshilfen von Apple, die sp?ter in diesem Jahr kommen, geh?rt Eye Tracking, womit Nutzer:innen des iPad und iPhone ausschlie?lich mit den Augen navigieren k?nnen.

CUPERTINO, KALIFORNIEN?Apple hat heute neue Bedienungshilfen angekündigt, die sp?ter in diesem Jahr kommen darunter Eye Tracking, womit Nutzer:innen mit k?rperlichen Einschr?nkungen ihr iPad oder iPhone mit den Augen steuern k?nnen. Music Haptics ist eine neue M?glichkeit für Nutzer:innen, die taub sind oder ein eingeschr?nktes H?rverm?gen haben, Musik mit der Taptic Engine des iPhone zu erleben. Mit Vocal Shortcuts k?nnen Nutzer:innen Aufgaben ausführen, indem sie ein bestimmtes Ger?usch machen. Vehicle Motion Cues k?nnen beim Verwenden von iPhone oder iPad im Auto dabei helfen, Reisekrankheitssymptome zu verringern. Zus?tzlich wird es weitere Bedienungshilfen für visionOS geben. Diese Features kombinieren die Power von Apple Hardware und Software und nutzen Apple Chips, künstliche Intelligenz und maschinelles Lernen auf dem Ger?t, um das jahrzehntelange Engagement von Apple zu unterstützen, Produkte für alle zu entwickeln.

?Wir sind von der transformative Kraft von Innovationen überzeugt, die das Leben verbessern kann“, sagt Tim Cook, CEO von Apple. ?Deshalb setzt sich Apple seit fast 40?Jahren für inklusives Design ein und integriert Bedienungshilfen von Grund auf in unsere Hardware und Software. Wir erweitern st?ndig die Grenzen des technologisch Machbaren und diese neuen Features zeigen, dass wir allen Nutzer:innen das bestm?gliche Erlebnis bieten wollen.“

?Bei Bedienungshilfen gehen wir jedes Jahr neue innovative Wege“, sagt Sarah Herrlinger, Senior Director of Global Accessibility Policy and Initiatives bei Apple. ?Die neuen Features werden die Leben vieler Nutzer:innen bereichern und ihnen neue M?glichkeiten bieten, zu kommunizieren, ihre Ger?te zu steuern und mobil zu sein.“

Eye Tracking kommt auf iPad und iPhone

Eye Tracking funktioniert mit künstlicher Intelligenz und gibt Nutzer:innen die M?glichkeit, ihr iPad und iPhone nur mit den Augen zu steuern. Das Feature wurde für Personen mit k?rperlichen Einschr?nkungen entwickelt und l?sst sich über die Frontkamera in wenigen Sekunden einrichten und kalibrieren. Durch das maschinelle Lernen auf dem Ger?t bleiben alle Daten, die zum Einrichten und Steuern des Features verwendet werden, sicher auf dem Ger?t und werden nicht mit Apple geteilt.

Eye Tracking funktioniert mit iPadOS und iOS?Apps und erfordert keine zus?tzliche Hardware oder Zubeh?r. Mit Eye Tracking k?nnen Nutzer:innen in Apps navigieren und die Verweilsteuerung nutzen, um Elemente in der App zu aktivieren. So k?nnen sie auf zus?tzliche Funktionen wie physische Tasten, Streichen und andere Gesten zugreifen – alles nur mit den Augen.

Music Haptics macht Songs für alle zum Erlebnis

Music Haptics ist eine neue M?glichkeit für Nutzer:innen, die taub sind oder ein eingeschr?nktes H?rverm?gen haben, Musik auf dem iPhone zu erleben. Wenn die Bedienungshilfe eingeschaltet ist, gibt die Taptic Engine im iPhone Tippimpulse, Texturen und andere Vibrationsmuster zur Musik aus. Music Haptics funktioniert mit Millionen von Songs aus dem Apple Music Katalog und wird als API für Entwickler:innen verfügbar gemacht, um Musik in Apps für alle zu einem Erlebnis zu machen.

Neue Features für inklusivere Spracherkennung

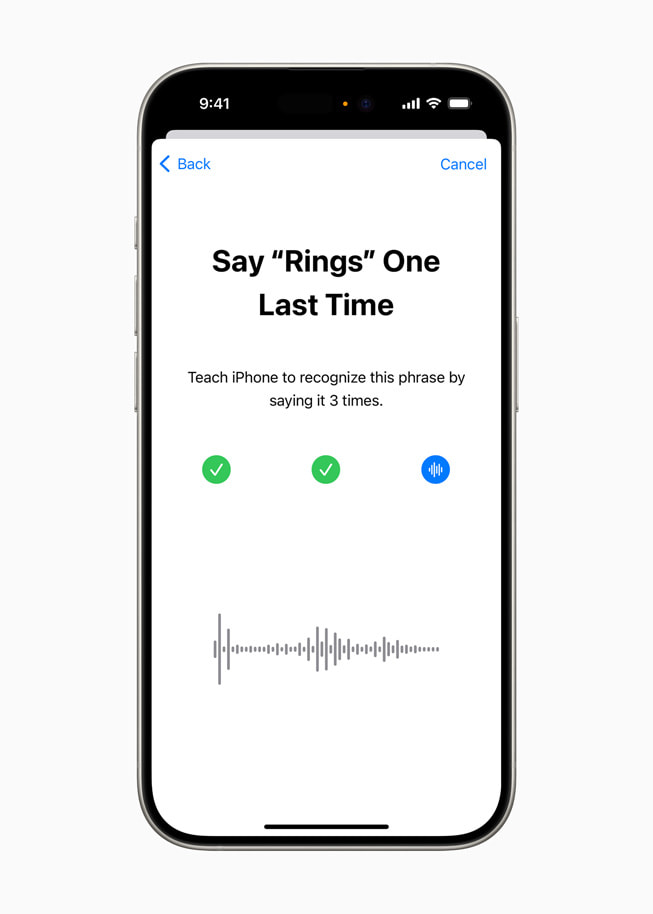

Mit Vocal Shortcuts k?nnen iPhone und iPad Nutzer:innen eigene ?u?erungen festlegen, die Siri versteht, um Kurzbefehle zu starten und komplexe Aufgaben auszuführen. Listen for Atypical Speech ist ein weiteres neues Feature für Nutzer:innen, das die Spracherkennung für ein noch breiteres Sprachspektrum erm?glicht. Das Feature nutzt maschinelles Lernen auf dem Ger?t, um Sprachmuster zu erkennen. Diese Features sind für Nutzer:innen mit angeborenen oder progressiven Beeintr?chtigungen des Sprachverm?gens, wie z.?B. Zerebralparese, Amyotrophe Lateralsklerose (ALS) oder Schlaganfall, entwickelt worden und bieten ein neues Ma? an Anpassung und Kontrolle. Sie bauen auf den Features auf, die in iOS?17 für Nutzer:innen eingeführt worden sind, die nicht sprechen k?nnen oder bei denen die Gefahr besteht, dass sie ihr Sprachverm?gen verlieren.

?Künstliche Intelligenz hat das Potenzial, Spracherkennung für Millionen von Menschen mit Sprachauff?lligkeiten zu verbessern und wir freuen uns, dass Apple diese neuen Bedienungshilfen vorstellt“, sagt Mark Hasegawa-Johnson vom Speech Accessibility Project am Beckman Institute for Advanced Science and Technology der University of Illinois Urbana-Champaign.??Das Speech Accessibility Project ist als breit angelegtes, von der Community unterstütztes Projekt ins Leben gerufen worden, damit Unternehmen und Hochschulen Spracherkennung zuverl?ssiger und effizienter gestalten k?nnen. Und Apple hat dazu beigetragen, das Speech Accessibility Project m?glich zu machen.“

Vehicle Motion Cues k?nnen Symptome von Reisekrankheit verringern

Vehicle Motion Cues ist ein neues Feature für iPhone und iPad, das Symptome von Reisekrankheit verringern kann. Forschungen haben gezeigt, dass die Reisekrankheit für gew?hnlich durch einen sensorischen Konflikt zwischen dem, was eine Person sieht, und dem, was eine Person fühlt, ausgel?st wird. Das kann es unangenehm machen, iPhone oder iPad im Auto zu verwenden. Mit Vehicle Motion Cues werden animierte Punkte am Displayrand angezeigt, die Ver?nderungen der Fahrzeugbewegung wiedergeben und so dazu beitragen, den sensorischen Konflikt zu verringern, ohne die Hauptinhalte zu beeintr?chtigen. Das Feature verwendet die Sensoren im iPhone und iPad, um Bewegungen w?hrend einer Fahrt zu erkennen und darauf zu reagieren. Es kann so eingerichtet werden, dass es automatisch auf dem iPhone erscheint, oder es kann im Kontrollzentrum ein- und ausgeschaltet werden.

CarPlay bekommt Sprachsteuerung und weitere Updates für Bedienungshilfen

CarPlay bekommt neue Bedienungshilfen, darunter Sprachsteuerung, Farbfilter und Ger?uscherkennung. Mit der Sprachsteuerung k?nnen Nutzer:innen in CarPlay navigieren und Apps bedienen - alles nur mit der Stimme. Die Ger?uscherkennung kann Fahrer:innen und Fahrg?ste, die taub sind oder ein eingeschr?nktes H?rverm?gen haben, über Mitteilungen auf Autohupen oder Sirenen aufmerksam machen. Für Anwender:innen, die farbenblind sind, machen Farbfilter die Nutzung der CarPlay-Oberfl?che visuell einfacher, mit zus?tzlichen visuellen Zug?nglichkeitsfunktionen wie beispielsweise Fetter Text.

Neue Bedienungshilfen für visionOS

Zu den Bedienungshilfen, die dieses Jahr zu visionOS kommen, geh?ren systemweite Live?Untertitel. So k?nnen alle – auch Nutzer:innen, die taub sind oder ein eingeschr?nktes H?rverm?gen haben – gesprochenen Dialogen in Live-Unterhaltungen oder in Audioteilen von Apps besser folgen. Mit Live?Untertiteln für FaceTime in visionOS wird es für viele Nutzer:innen noch einfacher, mit der Vision?Pro mit anderen in Verbindung zu bleiben und zusammenzuarbeiten. In der Apple Vision?Pro wird es m?glich sein, die Untertitel über die Fensterleiste in Apple Immersive Video zu verschieben. Und es kommt Unterstützung für zus?tzliche H?rger?te ?Made for iPhone“ und Cochlea-Geh?rprozessoren hinzu. Zu den Bedienungshilfen für Sehverm?gen kommen Reduce Transparency, Smart Invert und Dim Flashing Lights hinzu – für Nutzer:innen, die ein eingeschr?nktes Sehverm?gen haben oder helles bzw. schnell blinkendes Licht reduzieren m?chten.

Diese Features kommen zu den vielen Bedienungshilfen hinzu, die bereits in der Apple Vision?Pro verfügbar sind. Das erm?glicht ein flexibles Eingabesystem und eine intuitive Oberfl?che für viele unterschiedliche Nutzer:innen. Mit Features wie VoiceOver, Zoom und Farbfiltern bekommen auch Nutzer:innen, die blind sind oder ein eingeschr?nktes Sehverm?gen haben, Zugang zu r?umlichem Computing, w?hrend Features wie Geführter Zugriff Nutzer:innen mit kognitiven Einschr?nkungen unterstützen k?nnen. Anwender:innen k?nnen die Vision?Pro mit den Augen, H?nden und ihrer Stimme steuern – mit Bedienungshilfen wie Schaltersteuerung, Ger?uschaktionen und Verweilsteuerung, die Personen mit k?rperlichen Behinderungen unterstützen.

?Die Apple Vision?Pro bietet ohne Zweifel die zug?nglichste Technologie, die ich je verwendet habe“, sagt Ryan Hudson-Peralta, Produktdesigner aus Detroit, Accessibility Consultant und Mitgründer von Equal Accessibility LLC. ?Als jemand, der ohne H?nde geboren wurde und nicht laufen kann, wei? ich, dass die Welt in erster Linie nicht für Menschen wie mich geschaffen worden ist. Darum ist es toll zu sehen, dass visionOS einfach funktioniert. Es zeigt, wie stark und wichtig zug?ngliches und inklusives Design ist.“

Weitere Updates

- Für Nutzer:innen, die blind sind oder ein eingeschr?nktes Sehverm?gen haben, kommen in VoiceOver neue Stimmen, ein flexibler Voice Rotor, angepasste Lautst?rkesteuerung und die M?glichkeit, Tastaturkurzbefehle für VoiceOver auf dem Mac anzupassen.

- Die Lupe bekommt einen neuen Lesemodus und die Option, den Erkennungsmodus einfach mit der Actiontaste zu starten.

- Anwender:innen, die Braille nutzen, erhalten eine neue M?glichkeit, die Braillebildschirmeingabe zu ?ffnen und ge?ffnet zu lassen, für schnellere Steuerung und schnellere Texteingabe. Japanisch wird als Sprache für die Braillebildschirmeingabe verfügbar sein. Und es kommen Unterstützung für mehrzeiliges Braille mit Dot Pad sowie die Option, verschiedene Ein- und Ausgabetabellen zu w?hlen.

- Für Nutzer:innen mit eingeschr?nktem Sehverm?gen kann Hover Typing bei der Eingabe in Textfelder gr??eren Text in der bevorzugten Schriftart und -farbe anzeigen.

- Für Anwender:innen, bei denen die Gefahr besteht, dass sie ihre Sprachf?higkeit verlieren, wird Eigene Stimme in Mandarin verfügbar sein. Nutzer:innen, die Schwierigkeiten beim Aussprechen oder Lesen ganzer S?tze haben, k?nnen eine eigene Stimme mit verkürzten Ausdrücken erstellen.

- Für Nutzer:innen, die nicht sprechen, bringt die Live?Sprachausgabe Kategorien und gleichzeitige Kompatibilit?t mit Live?Untertiteln.

- Anwender:innen mit k?rperlichen Einschr?nkungen bietet Virtuelles Trackpad für AssistiveTouch die M?glichkeit, ihr Ger?t über einen anpassbaren Bereich auf dem Display zu bedienen, der als Trackpad funktioniert.

- Die Schaltersteuerung erh?lt die Option, die Kameras in iPhone und iPad zu verwenden, um Fingertipp-Gesten als Schalter zu erkennen.

- Die Sprachsteuerung bietet Unterstützung für angepassten Wortschatz und komplexe W?rter.

Welttag der Barrierefreiheit bei Apple

Anl?sslich des Welttags der Barrierefreiheit stellt Apple diese Woche neue Features, kuratierte Sammlungen und mehr vor:

- Im Mai wird es in ausgew?hlten Apple Stores kostenlose Sessions geben, in denen Kund:innen die Bedienungshilfen ihrer liebsten Produkte entdecken und ausprobieren k?nnen. Im Apple Store Piazza Liberty in Mailand wird das Talent hinter der viralen Kampagne ?Assume that I can“ anl?sslich des Welt-Down-Syndrom-Tags zu Gast sein. Und mit Gruppenreservierungen für Today at Apple Sessions, die das ganze Jahr über m?glich sind, werden die Apple Stores zu einem Ort, an dem sich Freund:innen, Familien, Schulen und Community Gruppen gemeinsam über Bedienungshilfen informieren k?nnen.

- Zu Kurzbefehlen kommen beruhigende Kl?nge hinzu, die Ambient-Sounds abspielen, um Ablenkungen zu verringern und dabei zu helfen, sich zu konzentrieren oder zur Ruhe zu kommen.

- Im App Store gibt es fantastische Apps und Spiele, die Barrierefreiheit und Inklusion f?rdern, wie das App Store Award-pr?mierte Game ?Unpacking“, Apps sowie Tools für erweiterte und alternative Kommunikation (AAC) und mehr.

- Die Apple?TV App stellt herausragende Creator:innen, Darsteller:innen und Aktivist:innen vor, die die Erfahrungswelten von Menschen mit Behinderung teilen. Das Thema in diesem Jahr hei?t Remaking the World. Jede Geschichte bildet dabei eine eigene Vision einer Welt ab, in der die Stimmen aller geh?rt werden.

- In Apple Bücher gibt es kuratierte Sammlungen mit Geschichten, in denen Autor:innen mit Behinderung von ihren gelebten Erfahrungen erz?hlen, als eBook und H?rbuch.

- Für Nutzer:innen, die taub sind oder ein eingeschr?nktes H?rverm?gen haben, gibt es in Apple Fitness+ Trainings, Meditationen und Tipps von Trainer:innen in amerikanischer Geb?rdensprache. Und Zeit fürs Gehen enth?lt jetzt Transkripte in der Apple Podcasts App. Fitness+ Trainings enthalten immer Audiohinweise für Nutzer:innen, die blind sind oder ein eingeschr?nktes Sehverm?gen haben, sowie Modifier, damit alle mittrainieren k?nnen.

- Vom Apple?Support erfahren Nutzer:innen, wie sie ihre Apple Ger?te mit integrierten Bedienungshilfen anpassen k?nnen. Vom Anpassen von Gesten bis zur Darstellung von Informationen auf dem Display – die Apple Accessibility Playlist zeigt Nutzer:innen, wie sie Apple Vision?Pro, iPhone, iPad, Apple Watch und Mac Computer so anpassen k?nnen, wie es für sie am besten ist.

Artikel teilen

Media

-

Text dieses Artikels

-

Bilder zu dieser Pressemeldung